Identidades en riesgo: el impacto de la Inteligencia Artificial

Rostro de hombre con códigos digitales haciendo referencia a la suplantación de identidad / vecteezy.com

-

El engaño tecnológico invade hogares, colegios y redes sociales, generando daños psicológicos y reputacionales

-

La identidad de cualquier persona puede ser manipulada con un simple clic

La Inteligencia Artificial (IA) ha comenzado a desarrollarse de tal manera que empieza a convertirse en una amenaza real en ciertos aspectos. Puede ser utilizado como una herramienta capaz de falsificar identidades con una precisión inquietante, potenciando el engaño y la manipulación. Con la IA, los atacantes clonan voces y rostros (deepfakes) para hacer una suplantación de identidad. Pero estos casos de suplantación ya no solo afectan a celebridades o usuarios en redes sociales, sino que también se están viendo afectadas empresas, institutos, empleados, menores y víctimas de pornografía no consensuada.

En pocos años, el engaño impulsado por la inteligencia artificial se ha convertido en una de las mayores preocupaciones para gobiernos , empresas y usuarios. Organismos internacionales, como Europol e INTERPOL, y nacionales, como INCIBE o la Guardia Civil, coinciden en que estas tecnologías capaces de suplantar identidades están creciendo muy rápido, tanto que superan la capacidad de reacción de las autoridades.

Fraude en ámbito económico

Debido a los avances de la Inteligencia Artificial, se ha elevado la delincuencia empresarial y las empresas han entrado en una era en la que la identidad ya no garantiza la seguridad. Las compañías tienen que lidiar con estafadores que clonan voces, rostros e incluso son capaces de introducirse en videollamadas con directivos de las grandes empresas.

Los estafadores clonan voces y usan deepfakes para hacerse pasar por directivos y conseguir información que solo personas de este rango pueden lograr. Con unas simples entrevistas, conferencias o vídeos corporativos son capaces de generar órdenes de transferencia que en principio son reales o solicitudes que solicitan pagos urgentes a números de cuenta que hagan pasarse por compañías.

Las empresas también pueden sufrir fraudes financieros por estafa telefónica . Los estafadores pueden hacerse pasar por el director financiero de una empresa, asesor o incluso por el CEO. Utilizan la IA para crear este tipo de llamadas que parecen realistas en las que suelen solicitar datos confidenciales como contraseñas temporales, autorizaciones, accesos a cuentas o datos bancarios. El problema de este tipo de estafas es que la víctima pocas veces es capaz de detectar que se trata de una llamada falsa pues utiliza un lenguaje, tono y acento diseñado especialmente para que parezca una persona confiable .

Otro de los elementos en las empresas que ha abierto una nueva ventana al fraude son las entrevistas online y el teletrabajo . Hay aspirantes que pueden usar deepfakes para presentarse a entrevistas haciéndose pasar por otras personas . Esto lo hacen para poder acceder a puestos sensibles como los financieros, obtener credenciales de las empresas y venderlas en el mercado negro o incluso cometer un robo de datos.

Este tipo de ataques a empresas no solo generan pérdidas económicas, sino que debilita la confianza entre empleados y directivos de la empresa, se pone en riesgo la protección de datos e incluso la estabilidad empresarial de la compañía.

Redes sociales

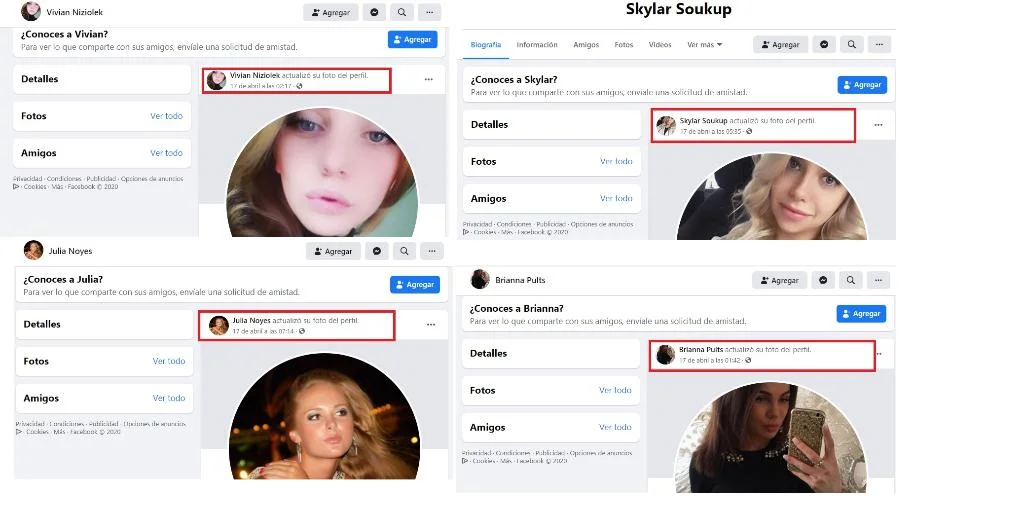

Las redes sociales se han convertido en una herramienta fundamental para quien esté buscando multiplicar los engaños mediante la Inteligencia Artificial. Debido a su rapidez, anonimato y capacidad de crear contenido instantáneo . La IA puede crear identidades falsas , interactuar con usuarios de la red e incluso sostener conversaciones durante horas o días.

La manera en la que nos comunicamos hoy en día ha cambiado en comparación a años atrás. Debido a esta evolución han aparecido nuevas herramientas para mantener conversaciones simuladas, como los chats automáticos que parecen humanos. Estos son capaces de mantener conversaciones durante días. Su método se basa en adaptar su personalidad a la del usuario que se está dirigiendo. Estos bots responden en tiempo real y emplean un lenguaje emocional para evitar ser descubiertos. Detectan el momento adecuado para proceder a pedir datos personales al usuario, así como números de verificación o dinero. Además, no es necesario que se centre en una víctima concreta, pues estos son capaces de gestionar a diferentes usuarios simultáneamente. Este tipo de engaño se está viendo en estrategias como “romance estafa” , donde la víctima desarrolla confianza afectiva con el bot, servicios de atención al cliente o perfiles presuntamente profesionales que ofrecen falsos empleos.

Otra de las estrategias es la creación de falsos influencers . Son perfiles aparentemente humanos, con un estilo coherente pero con una vida y rutinas ficticias. Estos perfiles publican contenido en las redes a diario, en apariencia reales, pero creados con Inteligencia Artificial. Además, interactúan con los usuarios de la red de manera, respondiendo comentarios o enviando mensajes personalizados. En un primer momento esto no parece suponer ningún riesgo, a priori , grave; el problema llega cuando estos bots se utilizan para promocionar productos fraudulentos , suplantar identidades reales o cuando pretenden propagar mensajes políticos adornados de un contenido cotidiano.

A esto, se le suma el mercado negro en la red . Estos perfiles también comparten contenido automatizado y crean historias sobre vidas creíbles. Se programan para que tengan interacciones en la red y así parecer humanas, tienen un comportamiento realista. Este tipo de perfiles actúan abriendo cuentas bancarias bajo identidades que son falsas. En la misma línea, pueden solicitar pequeños créditos a entidades bancarias o realizar estafas en diferentes plataformas como Vinted o Wallapop. En una era donde la IA generativa y la automatización están a la orden del día, la identidad se convierte en algo fácilmente manipulable.

Perfiles falsos en Facebook / ABC

Ciberbullying y suplantación en entornos escolares

Este escenario no se está quedando solamente en los falsos influencers o perfiles de personas adultas. El peligro está llegando a los colegios e institutos , lugar en el que la suplantación, o acoso digital pone en riesgo la identidad social y emocional de niños y adolescentes e incluso a las madres y padres de estos.

La Inteligencia Artificial ya permite crear imágenes completamente falsas para cualquier tipo de usuario. En este sentido, pueden crearse imágenes falsas de desnudos a partir de fotos normales de algunos alumnos del centro escolar para amenazar con chantajes económicos o emocionales e incluso concluir en su publicación para destruir la reputación del afectado. Esto puede crear graves daños pues es muy difícil demostrar que la imagen sea falsa y el impacto social de la misma puede durar años, generando graves daños psicológicos.

Estas nuevas tecnologías pueden servir como una herramienta peligrosa para los acosadores pues permite crear memes sobre algún alumno, manipular vídeos o difundir audios falsos en grupos escolares. Estos contenidos son muy fáciles de viralizar, y de que permanecen en la red, lo que aumenta el daño que se les causa a las víctimas. De este modo, no solo los alumnos pueden resultar damnificados, sino que los profesores también pueden sufrir consecuencias de la IA. Los alumnos pueden crear vídeos perjudicando a algún profesor a partir de dos fotos simples. Aunque en un futuro pueda justificarse que este contenido es falso, el daño se vuelve prácticamente irreparable pues la reputación de la persona afectada ya ha sido dañada en el momento de la publicación del contenido.

Adolescentes con teléfonos / ctxt.es

El problema que puede causar la Inteligencia Artificial no es solo tecnológico, en la mayoría de las ocasiones resulta en ser un daño humano. Puede generar daños psicológicos que derivan en ansiedad, miedo o estrés, además de manchar la reputación de alguien. Asimismo, los daños sociales no se quedan en un segundo plano pues las personas pueden resultar aisladas o sufrir una humillación pública.

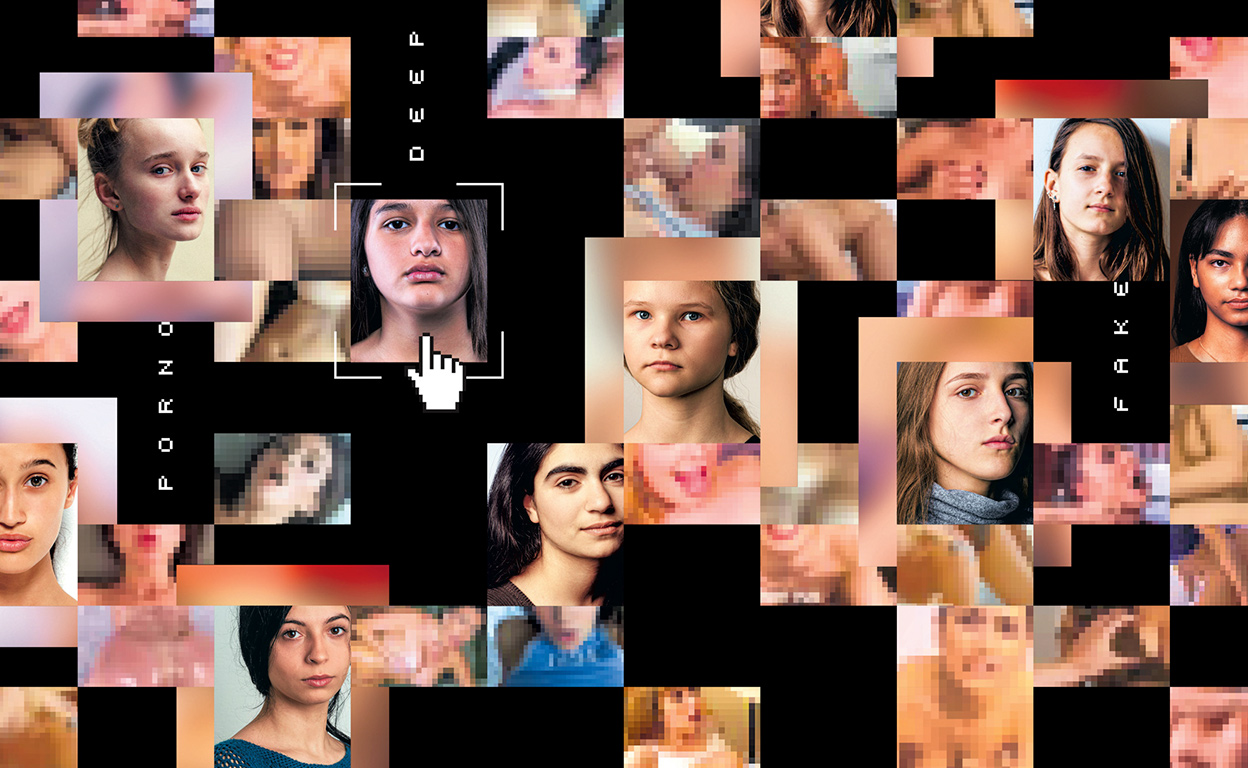

Pornografía deepfake

La evolución de la Inteligencia Artificial generativa ha causado una de las actividades más dañinas en el entorno de las redes, como es la pornografía deepfake . Esto afecta sobre todo a mujeres y menores, convirtiendo este contenido en una herramienta de humillación o chantaje . Cualquier imagen que sea pública puede convertirse en contenido sexual para la que nunca fue captada. Antes, este tipo de prácticas requerían conocimientos técnicos pero ahora pueden realizarse con webs gratuitas o tutoriales que circulan en internet.

Los deepfakes sexuales se han convertido en una de las herramientas más comunes de violencia digital. Los principales perfiles afectados en este ámbito suelen ser mujeres jóvenes que tengan perfiles creados en redes sociales como Instagram y TikTok y que cuenten con un elevado número de seguidores o micro influencers. También de adolescentes, sobre todo que se encuentren en entornos escolares. La gran parte de las afectadas descubren que se ha creado este tipo de contenido utilizado una de sus fotografías una vez que esto ya está publicado y lleva circulando días o semanas en la red.

Es una práctica muy peligrosa, ya que la creación de este tipo de contenidos están al alcance de cualquiera. En foros clandestinos o canales de Telegram existen avisos como “Deepnude por 10 euros” o “Montaje sexual en menos de una hora”. En estos canales, los usuarios facilitan herramientas de creación de pornografía deepfake o incluso encargan este tipo de montajes a cambio de una compensación económica. De esta manera, la creación de este tipo de contenidos es fácilmente realizable para cualquier persona sin necesidad de ser un experto en informática , solo basta con subir una foto.

Imágenes de mujeres con contenido explícito / ABC

Para muchas de las víctimas el daño no acaba cuando se difunde el vídeo o la imagen, realmente ahí es cuando empieza. Antes de la difusión al resto de internautas de la red, los agresores envían este contenido a la víctima y amenazan con publicarlo si no se le da lo que quiere –en la gran mayoría de los casos, dinero –. En ocasiones, en estos chantajes también se incluyen amenazas al círculo más cercano de la víctima.

El sufrimiento de la víctima no acaba aquí. Aunque trate de eliminar este contenido definitivamente y tome los aspectos legales para ello y consiga que la plataforma se deshaga del vídeo, el contenido ya ha podido ser descargado o reenviado. Por su parte, los procesos legales, en cuanto a temas referidos a la IA, son demasiado lentos como para que la víctima pueda olvidarse rápidamente de este suceso.

Estas herramientas no solo hacen que sea posible generar vídeos o imágenes sino que crean una “versión pornográfica interactiva” . Con estas tecnologías se pueden imitar voces a partir de clips o avatares que responden a ciertos mensajes de una forma sexualizada, además de chats eróticos que están diseñados con el rostro de la víctima aunque realmente no sea ella la que está participando en el chat.

El ámbito de la pornografía falsa es el ámbito que más resume las características de un mal uso de la IA y del deepfake . Entran en el juego factores como el anonimato , la velocidad con la que se crean los contenidos , la ausencia de un control legal o el daño psicológico que esto pueda causar. Este problema, vuelve a no tratarse de un problema tecnológico, sino que en este caso, se usa para violar la intimidad de las personas y ejercer el poder mientras se destruye su reputación.

Vida cotidiana

La Inteligencia Artificial no solo se queda en los ámbitos escolares, redes sociales o empresariales, sino que ahora se cuela en espacios donde antes las personas se sentían seguras. Se cuela en las casas, los teléfonos móviles, compras o incluso búsquedas de viviendas. La Inteligencia Artificial ha evolucionado tanto que ha logrado que los fraudes sean indistinguibles de la vida cotidiana y que parezcan completamente reales, aportando confianza y apelando a las emociones.

Una de las situaciones más comunes es la clonación de la voz de algún familiar con un mensaje de urgencia . La inmediata es una de las estrategias más utilizadas, pues de esta forma, no da tiempo a que la víctima se pare a pensar en si es una llamada real, o si efectivamente, se trata de una estafa. Este tipo de llamadas cada vez se producen más y se tratan de llamadas en la que escuchan la voz totalmente nítida de algún familiar que suplica ayuda inmediata como la necesidad de una transferencia bancaria a causa de algo urgente que haya ocurrido. Con solo unos segundos de grabación, los estafadores pueden clonar la voz de las personas y las usan para que las víctimas acudan a su ayuda de inmediato.

Llamada desconocida / Freepik

Otro de los fraudes más recurrentes es el financiero. Ahora, los estafadores ya no se hacen pasar por agentes bancarios usando su propia voz, sino que clonan la voz de un operador real, con la misma forma de hablar y con su mismo tono. Esta estafa utiliza un número falsificado que coincide con el del banco y el presunto agente que habla, replica exactamente los protocolos de seguridad del banco real para que su discurso sea totalmente creíble. Además, utilizan un sistema de IA que responde al momento como si se trata de un profesional.

A estos engaños se suma la compraventa online . Las plataformas que practican esta actividad viven de la confianza entre desconocidos, pero la Inteligencia Artificial ha hecho que esta confianza ciega desaparece. A día de hoy es posible crear perfiles que estén verificados pero que no pertenezcan a una persona real. Estos perfiles pueden contener vídeos donde el presunto vendedor muestra su rostro pero realmente son imágenes generadas con Inteligencia Artificial. Estos perfiles son capaces de mantener conversaciones fluidas y corrientes gracias a un bot conversacional e incluso pueden llegar a aportar justificantes o recibos instantáneos a los clientes. Es muy fácil que el comprador crea que está conversando con una persona real aunque todo sea fabricado por un sistema automatizado.

Ligado al problema de la vivienda y de la desesperación de los ciudadanos por conseguir un alquiler lo más rápido posible, es uno de los fraudes más en auge. Antes los estafadores usaban copias de otros anuncios reales . Ahora, con las nuevas tecnologías, muchas personas ofrecen visitas virtuales , lo que da lugar a que parte de ellas se tratan de visitas deepfake . En estos casos, normalmente suele tratarse de una videollamada con un casero creado por IA, contratos generados por la misma e incluso se muestran vídeos del interior del piso, que lejos de ser reales, también son imágenes creadas por Inteligencia Artificial o robadas de otros anuncios. En esta línea, los afectados no solo pierden su dinero sino que pierden la confianza ante otros anuncios que sí pueden resultar reales.

Respuestas institucionales y legales

Mientras el mal uso de la IA crece a niveles estratosféricos, los gobiernos, organismos de ciberseguridad y las plataformas digitales intentan poner límites a estas situaciones.

La Unión Europea ha aprobado dos normas para intentar frenar los abusos de la IA. Por un lado, la Ley AI ACT , que sienta las bases de la regulación de la IA en la UE. En ella se recoge que todos los contenidos generados o manipulados por IA, ya sean vídeos, audios o imágenes, deben estar designados como inteligencia artificial. Según esta ley, hay varios sistemas de IA prohibidos, como el uso de técnicas subliminales, manipuladoras o engañosas en las personas para distorsionar su comportamiento, explotar las vulnerabilidades relacionadas con la edad, discapacidad o circunstancias socioeconómicas, los sistemas que analizan datos biométricos para deducir información sensible de una persona (raza, religión, sexualidad, etc.), y evaluar a las personas o grupos diseñados en comportamientos sociales causando un trato desfavorable hacia ellos, entre otras. La AI Act prevé un sistema de multas según la gravedad de la infracción.

Por otra parte, la UE también ha establecido la Ley de Servicios Digitales (DSA) , que regula las plataformas y redes sociales . Su objetivo es garantizar un entorno online seguro para los usuarios y combatir los contenidos ilícitos. Esta ley obliga a los servicios digitales a sustentar sistemas de denuncia rápidos y efectivos , sistemas internos para detectar deepfakes y contenidos manipulados, sistema de retirada de contenido que vulnere los derechos de los usuarios y medidas contra la desinformación. La DSA tiene un régimen sancionador con multas severas en caso de incumplimiento de la normativa.

En España , se ha propuesto una ley propia para aplicar la AI Act europea. Esta ley define las infracciones respecto a la IA y qué multas les corresponden, que van desde millas hasta millones de euros. Esta ley incorpora las prohibiciones de la AI Act y está regulada en España por la AESIA (Agencia Española de Supervisión de la IA), que tiene como papel central supervisar y vigilar (coordinar a otras autoridades, inspeccionar expedientes, imponer sanciones, etc.); y otras autoridades reguladoras son AEPD , CNMV , Banco de España , entre otros. La ley recoge tres tipos de infracciones , leves, graves y muy graves, con multas que pueden llegar desde 15 millones de euros por infracciones muy graves en sistemas de alto riesgo, hasta 500.000€ por infracciones leves.

Además, el Instituto Nacional de Ciberseguridad (INCIBE) es un organismo de referencia en ciberseguridad y amenazas digitales en España. Se encarga de asesorar a ciudadanos , empresas y centros educativos sobre el uso malicioso de la inteligencia artificial. Informa a la ciudadanía sobre las técnicas de suplantación de identidad y cómo identificarlas; además de atender a víctimas que han sufrido fraudes impulsados por IA.

El desarrollo de la Inteligencia Artificial está suponiendo una amenaza digital en la que los usuarios se están viendo afectados. Lo que antes solo estaba limitado a personas con grandes conocimientos, ahora ya se necesita un hacker ni unas herramientas específicas, se ha convertido en una práctica al alcance de cualquiera . Las clonaciones de voz, los deepfakes o los bots automatizados se han multiplicado en los últimos años donde se han visto afectados usuarios de todo tipo, grandes empresas, adolescentes en institutos e incluso personas mayores.

Esta situación supone un problema en la sociedad, la pérdida de confianza . La IA hace cada vez más difícil distinguir la realidad de lo falso , y esto conlleva una manipulación, chantaje y acoso hacia las personas afectadas.

En un escenario donde la identidad puede ser copiada con un clic, la mayor defensa es una combinación de educación digital, prevención y responsabilidad colectiva. La IA no es, en sí misma, la amenaza, es el uso que hacemos de ella.